IEM Plug-in Suite

このチュートリアルでは、誰でも自由に利用することができる「オープン・ ソース」としてリリースされている高次アンビソニックス制作プラグイン「IEM Plug-in Suite」を使い、球体の音場に自由に音を配置し360°の音楽作品を作ることができる、Ambisonics(アンビソニックス)の面白さを皆さんに体験していただく為に、REAPERを使ったアンビソニック・プロダクションのセッションをゼロからセットアップする方法をご紹介いたします。

目次:

- 行うこと/必要なもの

- ルーティング

- ステップ1:3つのメインバスを作成

- ステップ2:バスの接続

- ステップ3:スピーカー用のハードウェア・アウトプットを作成

- ステップ4:ソーストラックを追加

- ステップ5:ルーティングをテスト/テンプレートとして保存

- テンプレートをダウンロード

行うこと/必要なもの

このチュートリアルでは、REAPERで高次アンビソニック(Higher Order Ambisonic = HOA)のテンプレート・プロジェクトを作成し、スピーカー及びヘッドフォン両方の再生に必要なルーティングを行います。このチュートリアルの最後に完成したREAPERプロジェクトのダウンロード・リンクがありますが、REAPERのルーティング機能を理解するためにも、少なくとも一度は、空のプロジェクトからスタートし、自身でルーティングを行ってみることをお勧めします。

必要なものはこれで全てです:

ルーティング

まず始めに、このチュートリアルで完成させるルーティングについて説明します。

多目的なプロジェクトにするために、今回は、アンビソニックのメイン・バスを1つと、それに対して個別の2系統のアウトプット・バス(スピーカー再生用とヘッドフォン再生用)を作成します。こうすることにより、アンビソニック化された音源が、スピーカー用にチャンネル・ベースの音源としてデコードされると同時に、ヘッドホン再生用としてバイノーラルでもデコードされ、モニタリングを行うことができます。

次の配線図を参照してください。

IEM Plug-inでは、ミックス/録音済のアンビエンス音源や、アンビソニックスに変換したい単一のオーディオ・ファイルなど、一般的なオーディオ・データであれば、おおよそ全て扱うことが可能です。従って、アンビソニックス専用のマイクロフォンなどを使わなくても、通常のマイクで収録した音源や、今まで録りためてきたオーディオ・ファイルなど、なんでも簡単にアンビソニックス化できる訳です。素晴らしいですね!

音源のオーディオ信号は、全てアンビソニック・バスにルーティングされ、このチャンネル上で、プラグインを使った全体のコンプレッション処理を行なったり、EnergyVisualizerを使用い再生音を視覚的に確認したりと、様々なアンビソニックスの処理を行う事ができます。

最後に、このアンビソニック・バスをレンダリング / バウンス / エクスポートすることにより、世界中の人が「デコード」すると、実際に「聴く」ことができるマルチ・チャンネルのAmbisonicsオーディオ・ファイルを書き出すことができるということになります。

アンビソニックス・ファイルは「デコード」を行わないと「聴く」ことができませんので、スピーカーモニター用のデコード・バス、ヘッドフォンモニター用のバイノーラル・バスを用意する必要があります。最終的にデコードされた信号はオーディオ・インターフェイスに送られ、スピーカーで再生されるようになります。

イマーシブ・サラウンドのモニタリング環境として、多数のスピーカーを用意することが難しい場合、また、電車や飛行機に乗っている時などでも、アンビソニックスをモニターすることは可能です。これには、バイノーラルという技術が必要です。バイノーラルは、立体的な音像をヘッドフォンで再現する技術で、アンビソニック・ミックスを誰でも簡単にヘッドフォンで聴くことができます。

このチュートリアルで作成するセッション ファイルでは、アンビソニック・バスからルーティングされたアンビソニック信号を、別に用意したバスにルーティングし、そのバス上で「BinauralDecoder」を使い、バイノーラルのヘッドフォン信号にデコードします。ここでは、IEM Plug-in Suiteに入っている「BinauralDecoder」を使いますが、もしその他のバイノーラル・デコーダーを持っている場合、それらを使用することも可能です。

ステップ1:3つのメイン バスを作成

REAPERで新規プロジェクトを開き(File > New Project)、3つのメイン・バス(

Ambisonics bus、

Loudspeakers bus、

Headphones bus)を作成します。バス トラックの作成は、Mixerウィンドウ(View > Mixer)にて、空のエリアをダブルクリックするだけです。バスにはそれぞれ名前を付けておくと便利です。

REAPERでは、トラックを作成すると自動的にステレオ・トラックが作成され、自動的にMASTERトラックにルーティングされます。今回のプロジェクトでは、各トラックの[ ROUTING ]ボタンをクリックして、チャンネルのルーティング・ダイアログを開き変更を行います。

Ambisonics Busでは、左上の[ Master send ](マスターへ送信)のチェックボックスを無効にします。

次に、[ Track channels ] にて、チャンネル数を希望する次元のアンビソニックスに必要なチャンネル数へと設定します。

アンビソニックスへとエンコードを行うためには、1トラック内に複数のバス・チャンネルが必要です。通常のDAWソフトウェアですとおおよそ16chが限界ですが、REAPERの場合は、最大64chまで1トラック内に展開することができるため、高次アンビソニックスにも対応しているのが特徴です。

1次アンビソニックス → 4チャンネル

2次アンビソニックス → 9 チャンネル

3次アンビソニックス → 16 チャンネル

4次アンビソニックス → 25 チャンネル

5次アンビソニックス → 36 チャンネル

6次アンビソニックス → 49 チャンネル

7次アンビソニックス → 64 チャンネル

このチュートリアルでは、5次でアンビソニックスを作成する流れを説明します。

以下のスクリーンショットでは、Ambisonics Busが5次アンビソニックス用に準備されていることがわかります。

Headphones busの[ Master Send ]チェックボックスを有効にします。バイノーラル化された2chのオーディオ信号はマスター・トラックに送られ、オーディオ・インターフェイスのメイン・ステレオ・アウトプットに直接送られます。

Loudspeakers busの設定は後ほど行います。

ステップ2:バスの接続

それでは、実際にルーティングを行ってみましょう。REAPERでは、とても直感的にルーティングを行うことができます。下のビデオのように、任意のトラックの[ ROUTING ] ボタンを別のトラックの[ ROUTING ] ボタンにドラッグするだけで、最初のトラックの出力は2番目のトラックにルーティングされます。まず始めに、Ambisonics Busの出力をLoudspeakers busの入力に接続してみましょう。

ルーティングのポップアップ・ウィンドウが開いたら、ウィンドウの1番下にある[ Audio ] と書かれた部分で「Multichannel source → 1-36」を選択し、36(または希望する次元の)チャンネルがすべて接続されるようにします。

ここで、先述の配線図に従って、それぞれのバスに色を割り当てましょう。(上記のビデオではすでに色がバスに割り当たっています)

トラックカラーを変更するには、トラック上で右クリックをし、表示されたメニューから[ Track color ]を選択します。

そして、次に、それぞれのバスに必要なプラグインをインサートします。

- Ambisonics Bus:「EnergyVisualizer」音をの位置を視覚化するプラグイン

- Loudspeakers Bus:「SimpleDecoder」スピーカーでの再生用デコーダー・プラグイン

- Headphones Bus:「BinauralDecoder」ヘッドフォン再生用デコーダー・プラグイン

ステップ3:スピーカー用のハードウェア・アウトプットを作成

まず、最初にお使いのオーディオ インターフェイスをREAPERに認識させる必要があります。

[REAPER] メニューより[Preferences...]を選択し、左のカラムより[Audio > Device]を選択します。そして、右カラムの[Audio Device:]にてご希望のオーディオ・インターフェイスを選択します。ここでは、1台で最大7.1.4 (12ch)イマーシブ・セットアップが可能なRMEのFireface UFXシリーズを使い説明を行います。

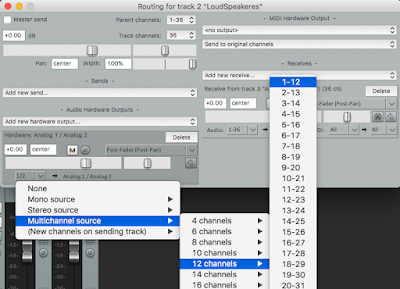

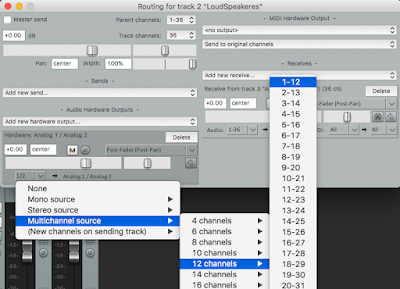

Loudspeakers bus のルーティング・ダイアログを開き:

- [ Audio Hardware Outputs ]セクションにてオーディオインターフェイスの最初のチャンネル「1: Analog 1 / Analog 2」を選択します。

- 表示されたセクションの一番左下にある「1/2」と表示されたプルダウンメニューより、スピーカーの数に合ったチャンネル数をアサインします。

ここでは、7.1.4 イマーシブ サラウンドのスピーカー・レイアウトを作成しますので、7 + 1 + 4 = 12チャンネル必要になります。[Multichannel Source]にて[12 Channels] > [1-12]を選択します。

Fireface UFXシリーズの場合、この設定を行うと、各スピーカーの信号は、Analog 1からPhones 12で出力されますので、実際の結線は、以下のようになります。

*Phones 9/10、11/12は、Yケーブルを使って接続します。接続に関する詳細は、

こちらをご参照ください。

イマーシブ・サラウンドの環境を構築する際は、DSPで各スピーカーの周波数やボリュームを調節することができる機能をもつアクティブ・スピーカーがおすすめです。例えば、

GenelecのSAMシリーズを使用すると、専用マイクを立てて測定を行うだけで、全てのスピーカーが正しく設定されるため、より正確なアンビソニックスの球体音場の再現が可能です。

このチュートリアルでは、事前に7.1.5フォーマットで作成したプリセットファイルを読み込んでお使いください。

7.1.4フォーマットのプリセットファイルをダウンロード

Genelec 7.1.4 layout.json

ダウンロードが完了すると「Genelec 7.1.4 layout.json」というファイルが保存されますので、このファイルを先ほどLoudspeakers busにインサートした「SimpleDecoder」にファイルを読み込んでお使いください。

SimpleDecoderのウィンドウから[Load configuration]をクリックしてダウンロードした「Genelec 7.1.4 layout.json」ファイルをLoadするだけでOKです。

[AllRADecoder]は、このプリセットファイル(.json: ジェイソン ファイル)を作成するのに使用するプラグインです。このプラグインにダウンロードした「Genelec 7.1.4 layout.json」ファイルを[Import]すると、スピーカーレイアウトの情報が確認できます。

AllRADecoderでのjsonファイルの作成方法は、多少解説が長くなりますので、後日詳細を掲載しようと思いますが、今回のプリセットを読み込み、ご自宅の環境に合わせてスピーカー配置や角度を調整し[EXPORT]すると、よりご自身の環境に合ったjsonファイルを作成することができますので是非お試しください。

ステップ4:ソース(音源)トラックの追加

ここまでのステップで、オーディオをアンビソニックス化する下準備は全て整いましたので、ここから実際にトラックを追加し音源を配置していきます。

Ambisonics Busの下の空いているエリアをダブルクリックし、新規トラックを必要数(複数)追加します。REAPERには非常に手軽で直感的なグルーピング機能があり、新たに追加作成したトラックをShift+クリックで複数選択し、Ambisonics Busの上にドラッグするだけでトラックがグルーピングされ、各トラックの出力が自動的にAmbisonics Busに流れるように設定されます(デフォルトで設定されていますので、特に確認する必要はありませんが、各トラックの[Parent Send]は有効になっている必要があります)。任意のアンビソニックの次元に従って各トラックのサイズを設定することを忘れないようにしましょう。

各トラックの[ ROUTING ]ボタンをクリックして、表示されたウィンドウで36chを選択してください(このチュートリアルでは5次のアンビソニックスを作成しているため、36chを選択しています。次数に合わせてチャンネル数は変更してください。)。

これらのソーストラックには、音源ファイルを配置すると同時に、チャンネルや用途に合ったエンコーダー プラグインをインサートし、音源ファイルをアンビソニックス化します。

IEM Plug-in Suiteには、用途に合わせた3種類のエンコードプラグインが収められています。

-

SimpleEncoder:monoまたはstereoファイルをアンビソニックスにエンコードします。

- MultiEncoder:3チャンネル以上のインターリーブ・ファイルをアンビソニックスにエンコードします。

- RoomEncoder:部屋の反射などをシミュレートするプラグインです

。

このチュートリアルでは、SimpleEncoderとMultiEncoderを使います(3つ目のRoomEncoderは、また別の機会に詳しく解説します)。

SimpleEncoder

SimpleEncoderは、monoまたはstereoファイルに対して使います。操作はシンプルです。ウィンドウの左側の円はパンナーとなっており、「白い玉」をマウスで掴んで自由に動かすことができます。アンビソニックスは360°の球体の音場で、このパンナーはその球体を真上からみている図です。下半球にパンニングが移動した場合は、「白い玉」は「R」と書かれた赤字の表示になります。[Elevation]ノブを動かすと全球を縦方向にパンニングできます。

MultiEncoder

MultiEncoderは、3チャンネル以上のインターリーブ・ファイルに対して使ってください。例えば、Dolby AtmosやAuro 3Dなどのイマーシブのインターリーブ・ファイルや、22.2chのイマーシブのインターリーブ・ファイルなどには、MultiEncoderを使います。

使い方は、最初にオーディオ・ファイルのチャンネル数に合わせて、左肩の数字を調整するだけで、あとはSimpleDecoderと基本的には同じです。

これらのパラメーターは、もちろんオートメーションが可能ですので、オブジェクトベースのイマーシブオーディオのように自由に音源を立体的にパンニングさせることが可能です。

ステップ5:テンプレートとして保存

これで全ての準備が整いました。それでは実際にトラックにオーディオ ファイルをドラッグしてアンビソニックスに変換しアンビソニックスの効果を確認してみましょう!

Loudspeakers busもしくはHeadphones busのどちらかを忘れずにミュートしてください(同時に使用したい場合を除く)。

結果に満足したら、テンプレートとしてこのREAPERプロジェクトを保存することをお勧めします。

File(ファイル) → Project template(プロジェクト・テンプレート) → Save project as template(プロジェクトをテンプレートとして保存)

「Ambisonic Production 05(5次アンビソニック制作)」など、分かりやすい名前を付けておけば、新しいアンビソニック・プロダクションをスタートする場合も、このテンプレートを読み込めばすぐに作業が始められます。

テンプレートをダウンロード

3次/5次/7次のアンビソニック制作用のテンプレートをダウンロードして頂けます。

Ambisonic_Production_Templates.zip

Loudspeakers bus にハードウェア・アウトプットを忘れずに追加するようにしてください。

最後に

このブログで紹介しております「IEM Plug-in Suite」は「オープン・ ソース」です。

つまり、誰でも自由にダウンロードして使用することができます。

音楽の国として世界的に有名なオーストリアにて200年以上の歴史を持つグラーツ国立音楽大学は、オーストリアに存在する3つの国立音楽大学の1校であり、現代音楽をリードする音楽学校として広く知られています。そして、このグラーツ国立音楽大学では、実は、過去20年の間、積極的にAmbisonicsの研究が行われており、この「IEM Plug-in Suite」は、その貴重な研究結果を、全ての人が簡単に体験できるようにと、汎用性の高いVSTプラグインの形にまとめられたものとなります。少し難しい話になってしまいますが、近代Ambisonicsのフォーマットとして有名な「AmbiX」も、実はこのグラーツ国立音楽大学にて生まれています。そういう意味では、この「IEM Plug-in Suite」は、まさにAmbisonicsの「正統」であり「源泉」であると言えます。

専用マイクや高価なハードウェアなどは必要ありません。実は、誰でも簡単に、すでにお手持ちのオーディオファイルを「アンビソニック化」することができます。

皆さんも是非この機会にAmbisonicsをお試しください!

イマーシブオーディオ、Ambisonics(アンビソニックス)に関するソリューションをご検討の際は、ご気軽に下記までご連絡ください。

「IEM Plug-in Suite」のデモンストレーションや解説から、オーディオインターフェイスやコンバーターの選定、スピーカーの選定まで、専任のスタッフが詳しくご案内いたします。

--------------------------------------------------------------------------------------------------------------------------------------------------------

本ドキュメントの著作権は株式会社シンタックスジャパンと著作者に帰属します。無断複写・転載を禁じます。

ドキュメントの記載事項は制作時点のものであり、将来的に予告なく変更される場合があります。

また内容を保証するものではありません。文中の会社名および製品名は各社の商標または登録商標です。

Copyright (c) 2018 Synthax Japan Inc. , author by Takeshi Mitsuhashi